막간 - 정리한거 찾다가 발견한 눈물의 대똥꼬쇼

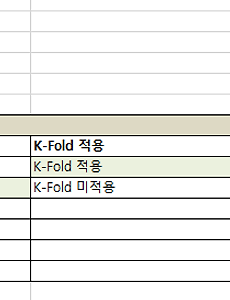

LSTM으로 수요예측을 하는 것은, 거의 혼자 힘으로 개발했다...ㅋㅋ 선임이 한분 계셨는데, 작업 할 때 다른 업무로 바쁘셔서 잘 못도와주시다가, 나는 당장 모델부터 뽑아서 뭔가 보여줘야했어서, 대신 EDA를 도맡아서 해서 공유해주셨고, 추후에 모델 검증에서 많은 도움을 주셨다. 그러다보니, 여러가지 아키텍쳐 적인 가설과, 데이터 구성에 대한 생각, loss펑션의 합리성, 등등 단계별로 시도해봐야 할 시나리오 케이스가 상당히 많아서 나 스스로도 정리가 안됐었는데, 찾아보니 이런게 있었다. ㅋㅋ 하나하나 경험적으로 해봤던 것들을 전부 CASE 별로 정리하고, 어떤게 더 나았었는지 체크해놓은 엑셀이 있었다. (그때는 머리 뜯어가며 고통이었는데, 지금보니 추억이네.) 이 시절에 저 해당 시나리오별로 하나씩 ..

2021. 4. 12.

막간 - 정리한거 찾다가 발견한 눈물의 대똥꼬쇼

LSTM으로 수요예측을 하는 것은, 거의 혼자 힘으로 개발했다...ㅋㅋ 선임이 한분 계셨는데, 작업 할 때 다른 업무로 바쁘셔서 잘 못도와주시다가, 나는 당장 모델부터 뽑아서 뭔가 보여줘야했어서, 대신 EDA를 도맡아서 해서 공유해주셨고, 추후에 모델 검증에서 많은 도움을 주셨다. 그러다보니, 여러가지 아키텍쳐 적인 가설과, 데이터 구성에 대한 생각, loss펑션의 합리성, 등등 단계별로 시도해봐야 할 시나리오 케이스가 상당히 많아서 나 스스로도 정리가 안됐었는데, 찾아보니 이런게 있었다. ㅋㅋ 하나하나 경험적으로 해봤던 것들을 전부 CASE 별로 정리하고, 어떤게 더 나았었는지 체크해놓은 엑셀이 있었다. (그때는 머리 뜯어가며 고통이었는데, 지금보니 추억이네.) 이 시절에 저 해당 시나리오별로 하나씩 ..

2021. 4. 12.